こんにちは、牧野真です。

会議の記録や、インタビュー記事、対談など、音声データは、勉強になるものがたくさんありますね。(書籍の音声もある)

音声をそのまま聞いても、内容が理解できないことはないのですけど、

文章(テキスト)で読むと、理解がさらに深まります。

音声認識ソフトウェア:Whisperを使えば、文字起こしが「無料」かつ、

カンタンにできることをご存じでしょうか?

Google Colaboratory環境で、whisperをインストールして、音声データをアップロードすれば、文字起こしが開始されます。

ChatGPTを使うと、文字起こしの内容が大幅に良くなります。

こんにちは、牧野真です。

会議の記録や、インタビュー記事、対談など、音声データは、勉強になるものがたくさんありますね。(書籍の音声もある)

音声をそのまま聞いても、内容が理解できないことはないのですけど、

文章(テキスト)で読むと、理解がさらに深まります。

文字起こしツールは、国産海外産含め、たくさんありますが、

多くのツールは費用がかかります(有料)。

中には、毎月課金させられるものもある。

しかし、OpenAIが開発した音声認識ソフトウェア:Whisperを使えば、

文字起こしが「無料」かつ、カンタンにできることをご存じでしょうか?

Google Colaboratory環境で、whisperをインストールして、音声データをアップロードすれば、文字起こしが開始されます。

ただ、この段階の文字起こしは、音声が単純に文章化されただけの

「未整備のテキストデータ」で、

・読んでも内容がわかりにくかったり、

・対談データでは、誰の発言か、判別しないものになります。

・誰の発言が判別できない

そこで、この「未整備テキストデータ」をChatGPTを使って、ブラッシュ

アップするのです。

文脈を整えたり、対談であれば、発言者別にテキストを並び変えます。

一見、面倒なように見えますが、慣れてしまえば、そんなに難しくは

ありません。

その手順をご紹介しますね。

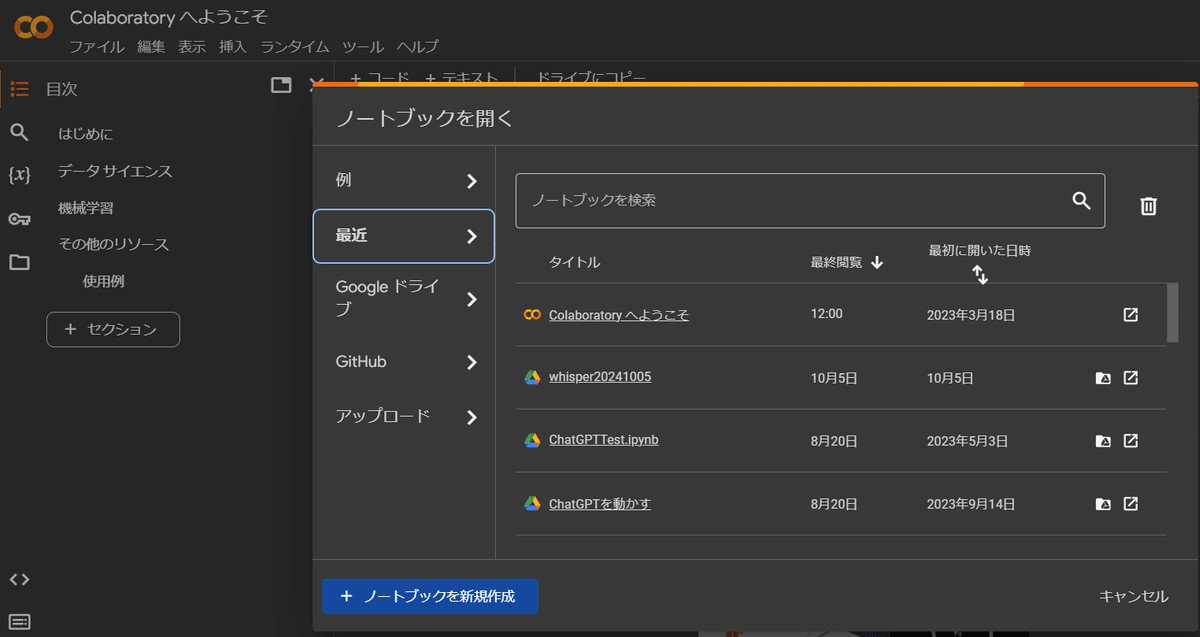

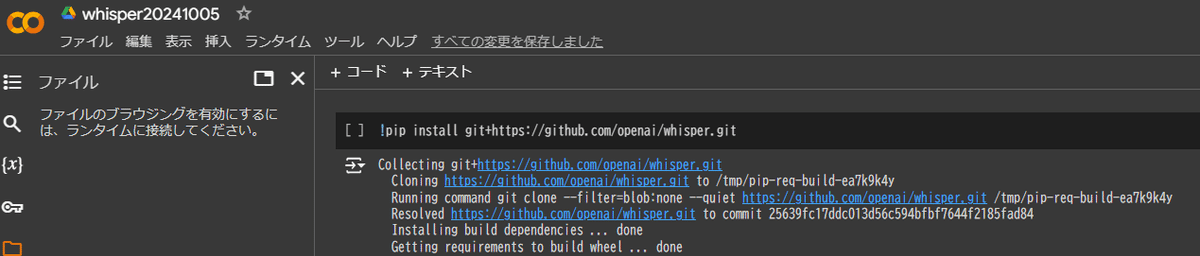

■ステップ1

Google Colaboratory環境で、whisperをインストール

①Google Colabにアクセスし、新しいノートブックを作成

②右上の「接続」をクリック⇒「接続」が「RAMディスク」と表示される

③コード入力欄に、以下のコマンドを入力して実行ボタン(▷)をクリック

!pip install git+https://github.com/openai/whisper.git

④実行が完了したら、左上の「+コード」をクリック

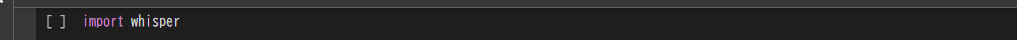

⑤コード入力欄に「import whisper」と入力し実行ボタン(▷)をクリック

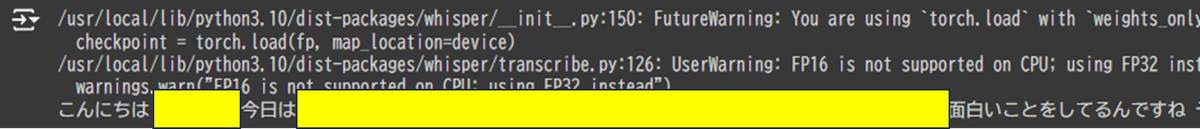

■ステップ2

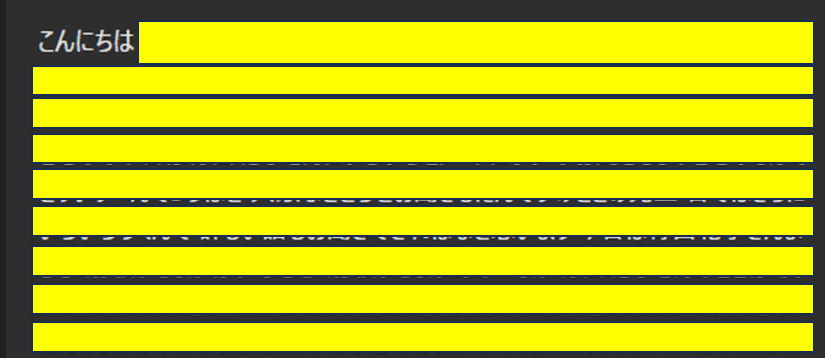

Google Colaboratoryに音声データをアップロード

※文字起こしが開始されます

⇒未整備のテキストデータができあがる(黄色の部分)

⑥左上のファイルの一覧から「content」を選択して、

文字起こししたい音声ファイルをcontentにドラッグ

⑦アップロードが完了したら「+コード」をクリック

⑧灰色の入力欄に、下記のコードを入力し、再生マークをクリック

model = whisper.load_model('base')

result = model.transcribe('ファイル名')

print(result['text'])⑩これで準備完了です。

Whisperの文字起こしが開始されます

(黄色の箇所が、実際に、文字起こしされたテキストデータです)

ステップ1とステップ2の手順は、ネットでたくさん公開されているので、

そちらを参考にしてみてください。

(whisper、Google Colaboratoryなどで検索)

■ステップ3

未整備データをChatGPTでリライト

(意味を分かりやすくするなど修正)

肝心なのは、ステップ3です。

ChatGPTに、意味が分かる文章にリライトさせます。

対談ならば、発言者名を入れることも可能です。

(※発言者がミスすることもあるので、その場合は何度か修正する)

<プロンプト例>

以下は、2人の対談の音声データの文字起こしです。

意味が分かりやすくなるように、改行を入れて見やすくしてください。

♯発言者2人の名前を入れる。

発言者:田中、青木

<音声データ>

<ChatGPTの出力例>

このChatGPTを使ったリライト方法には、大きな問題点が

一つあります。

それは、音声ファイルの全文章をリライトするのではなく、重要と思えない文章の内容をChatGPTが勝手にカットしてしまうこと。

全文の文字起こしには、なっていない。

大局的に内容を把握するには良いのですけど。

(※プロンプトを色々試しましたが、うまい解決策が見つかっていません)

この音声データを文字起こしする方法、

いろいろ使い道があります。

勉強家の人にとっては、知っておいた方が良い手順だと思います。

概略の解説で少しわかりづらかったかもしれませんが、

音声データの文字起こしに興味ある方は、

ぜひチャレンジしてみてください。